炒股就看金麒麟分析师研报,巨擘,专科,实时,全面,助您挖掘后劲主题契机!

起原:量子位

AI不外周末,硅谷亦然如斯。

大周日的,Llama家眷上新,一群LIama 4就这样倏得发布了。

这是Meta首个基于MoE架构模子系列,咫尺共有三个款:

Llama 4 Scout、Llama 4 Maverick、Llama 4 Behemoth。

终末一个尚未推出,只是预报,但Meta仍是侃侃谔谔地称前两者是“咱们迄今为止起始进的型号,亦然同类家具中最佳的多模态型号”。

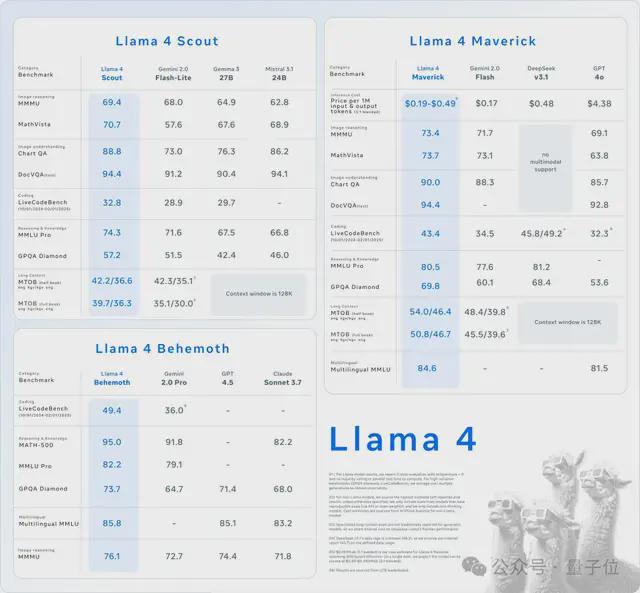

详备来看一些要道词——

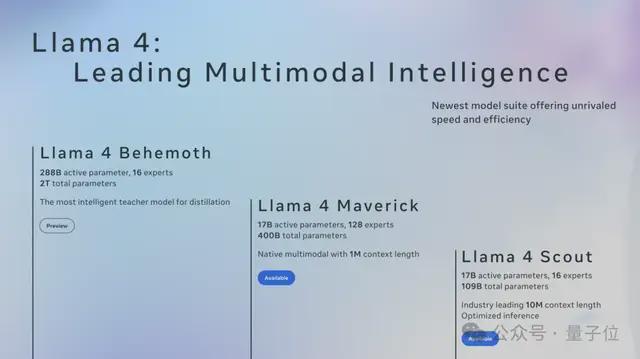

Llama 4 Scout,16位行家的170亿激活参数的多模态模子,单个H100 GPU可运行, 同类SOTA,并领有10M凹凸文窗口

Llama 4 Maverick,128位行家的170亿激活参数多模态模子,打败GPT-4o和Gemini 2.0 Flash,与DeepSeek-V3同等代码本事参数只消一半,主打与DeepSeek通常的性价比,单个H100主机即可运行。

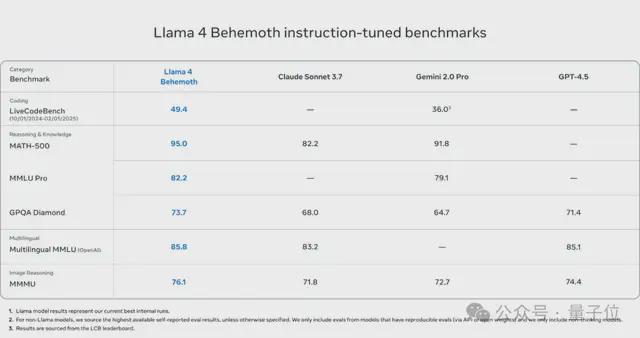

Llama 4 Behemoth:2万亿参数的超大超强模子,以上二者王人由这个模子蒸馏而来;咫尺还在教诲中;多个基准测试越过GPT-4.5、Claude Sonnet 3.7和 Gemini 2.0 Pro。

Meta官推心境示意,这些Llama 4模子象征着Llama生态系统新时间——原生多模态AI革命的入手。

与此同期,大模子竞技场名次迎来一轮更新。

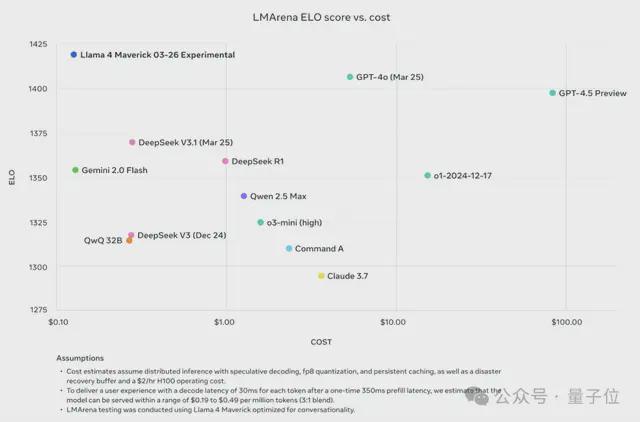

这次发布的Llama 4 Maverick,在贫瘠指示、编码、数学、创意写稿方面比肩第一;得分1417,不仅大大卓绝了此前Meta自家的Llama-3-405B(提高了149分),还成为史上第4个冲破1400分的模子;。

而况跑分明确——卓绝DeepSeek-V3,竣事亮相即登顶,平直成为名按次一的开源模子。

谷歌CEO劈柴哥第一时期发来贺电:

中杯、大杯首批亮相

了解了Llama 4家眷全体成员后,咱们先来主张一下首批发布的2个模子:

两者均已能在Llama官网和抱抱脸凹凸载。

咱们抓取并索要出这俩模子的一些特色:

Meta首批MoE架构模子

这是Llama系列,第一批使用MoE(混杂行家模子)构建的模子。

中杯Llama 4 Scout有17B激活参数,领有16个行家模子。

大杯Llama 4 Maverick领有17B激活参数,领有128个行家模子。

至于还没和人人认真碰面的超大杯Llama 4 Maverick,领有288B激活参数,领有16个行家模子。

特别长————的凹凸文

Llama 4系列,均具有很长的凹凸文窗口。

这极少主要体咫尺Meta公布的中杯Llama 4 Scout的详备数据里:

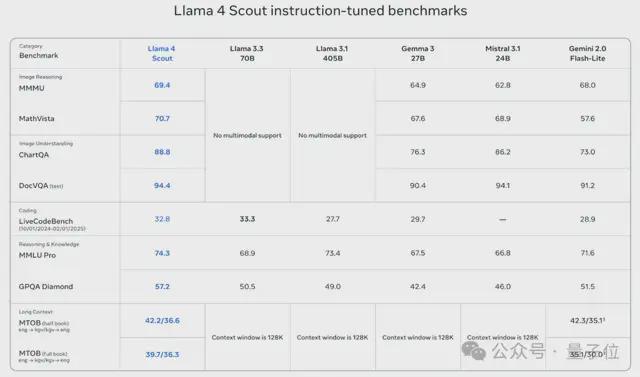

这个树立,让它在普通的测评集上,比Gemma 3、Gemini 2.0 Flash-Lite和Mistral 3.1的末端更优秀。

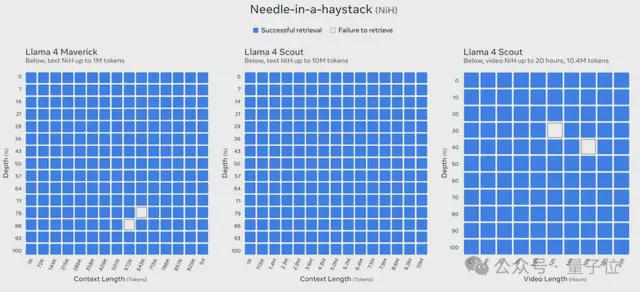

它在‘大海捞针’测试上的进展如下:

末端如下:

那么之前的Llama系列模子的凹凸文窗口情况呢?

Meta官方博客中是这样写的:

原生多模态假想

Llama 4系列,开启了Llama的原生多模态时间。

辛勤经公开对外的中杯和大杯,被官方称为“轻量级原生多模态模子”。

给用户的体验即是,上传一张图片,不错平直在对话框中发问对于这张图片的多样问题。

不是我说,Llama终于长眼睛了!!!

上头这张动图展示的只是是最基础的,“为难”程王人升级也不怕。

比如喂它一张铺满器具的图片,问它哪些恰当来干某个活。

它会很快地把适用的器具圈出来:

要认情态+认小鸟,也没在怕的:

中杯和大杯王人在官方先容中被打上了“宇宙上同类家具中最佳的多模态模子”的tag。

来看和Llama系列前作、Gemma 3、Mistral 3.1、Gemini 2.0 Flash-Lite的对比末端——

不错看到,在各个测评集上的进展,Llama 4 Scout样样王人是新SOTA。

讲话资质Max

经过了预教诲和微调的Llama 4,掌抓全球12种讲话,以此“便捷全球开荒者的部署”。

比DeepSeek更狠的“AI模子拼多多”

一定要跟人人分享的一个细节,Meta这次在模子API价钱方面,下狠手了!

先说末端:

系列超大杯Llama 4 Maverick,不仅卓绝了同类型号其它模子,价钱还特别之绮丽。

更直不雅地来看这张表格,果然狠过DeepSeek——从性能到价钱各个纬度。

要知谈,超大杯Llama 4 Behemoth属于是Llama 4系列的锻真金不怕火模子。

要是说中杯和大杯是轻量级选手,这位即是所有的重磅玩家。

288B激活参数,16个行家模子。

最伏击的是,它的总参数目高达2000B!

在数学、多讲话和图像基准测试中,它提供了非推理模子的起始进性能。

当“最牛”和“最低廉”摆在一谈的时候,试问哪位开荒者会不心动?(doge)

教诲细节

用他们我方的话来说,Llama系列是进行了透澈的再行假想。咫尺第一组LIama 4系列模子,他们也公布了具体的教诲细节。

预教诲

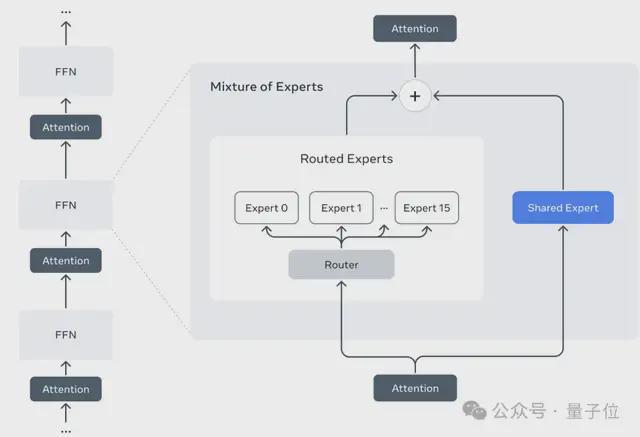

他们初次使用混杂行家MoE架构,在MoE架构中,单个token仅激活总参数的一小部分。MoE架构在教诲和推理方面具有更高的策画恶果,固定教诲FLOP本钱情况下质料更高。

比如,Llama 4Maverick模子有17B个激活参数和400B个总参数。他们使用轮换的密集层和混杂行家(MoE)层来提高推理恶果。

MoE层使用128位路由(Routed)行家和一位分享行家。每个令牌王人会发送给分享行家以及128位路由(Routed)行家之一。

因此,天然所有参数王人存储在内存中,但在为这些模子提供办事时,唯有总参数的子集被激活。

这通过裁汰模子办事本钱和延长来提高推理恶果——Llama 4 Maverick 不错在单个H100 DGX主机上运行,以便于部署,也不错通过散布式推理竣事最高恶果。

他们早期交融,将文本和视觉token无缝集成到融合模子中。

他们开荒了一种新的教诲时候:MetaP,不错建造要道模子超参数,比如每层的学习率和入手化步伐。

末端发现,所选的超参数能在批量大小、模子宽度、深度和教诲token的不同值之间很好地扩张和泛化——

Llama 4通过在200种讲话(包括100多种讲话,每种讲话有越过10亿个词库)上进行预教诲,竣事了开源微调责任,多讲话词库总量是Llama 3的10倍。

此外,他们使用FP8精度进行高效模子教诲,同期不葬送质料并确保模子 FLOPs的高诈骗率—在使用FP8和32K GPU 预教诲 Llama 4 Behemoth模子时,末端他们竣事了390TFLOPs/GPU。

用于教诲的合座混杂数据包括30多万亿个token,是Llama 3预教诲混杂物的两倍多,其中包括多样文本、图像和视频数据集。

在所谓的“中期教诲”中络续教诲模子,通过新的教诲方法(包括使用专科数据集进行长凹凸文扩张)来提高模子的中枢功能。

后教诲

后教诲阶段,他们忽视一个课程战术,与单个形态行家模子比拟,该战术不会葬送性能。

在Llama 4中,接管了一种不同的方法来调动咱们的后期教诲管谈:

轻量级监督微调(SFT)>在线强化学习(RL)>轻量级平直偏好优化 (DPO)。

一个要道的训导是,SFT和DPO可能会过度不断模子,末端在线强化学习阶段的探索,并导致精度裁汰,尤其是在推理、编码和数学鸿沟。

为了处置这个问题,他们使用Llama模子看成评判步伐,删除了50%以上被象征为浅近的数据,并对剩余的较难数据集进行了轻量级SFT处理。

在随后的在线强化学习阶段,通过仔细遴荐较难的指示,咱们竣事了性能上的飞跃。

此外,他们还践诺了一种连气儿的在线强化学习战术,即轮换教诲模子,然后诈骗模子连接过滤并只保留中等难度到较高难度的指示。事实说明,这种战术在策画量和准确性的衡量方面特别有益。

然后,他们接管轻量级DPO来处理与模子反馈质料联系的拐角情况,从而有用地在模子的智能性和对话本事之间竣事了考究的均衡。活水线架构和带有自适合数据过滤功能的连气儿在线RL战术,终末种植了咫尺的LIama 4。

转头来看,Llama 4架构的一项要道革命是使用交错瞩眼力层,而无需位置镶嵌。此外,他们还接管了瞩眼力推理时期温度缩放来增强长度泛化。

这些他们称之为iRoPE架构,其中“i”代表 “交错 ”瞩眼力层,隆起了赞成 “无尽”凹凸文长度的始终方针,而 “RoPE ”指的是大多半层中接管的旋转位置镶嵌。

Llama 4 Behemoth

终末,他们还表示了超大模子Llama 4 Behemoth一些蒸馏和教诲细节。

咱们开荒了一种新颖的蒸馏亏空函数,可通过教诲动态加权软方针和硬方针。

预教诲阶段,Llama 4 Behemoth的代码蒸馏功能不错摊销学生教诲中使用的大部分教诲数据策画蒸馏方针所需的资源密集型前向传递的策画本钱。对于纳入学生教诲的其他新数据,他们在Behemoth模子上运行前向传递,以创建蒸馏方针。

后教诲阶段,为了最大限制地提高性能,他们删减了95%的SFT数据,而微型模子只需删减50%的数据,以竣事对证料和恶果的必要存眷。

他们在进行轻量级SFT后,再进行大限制强化学习(RL),模子的推理和编码本事会有更显赫的提高。

强化学习方法侧重于通过对战术模子进行pass@k分析来抽取高难度指示,并把柄指示难度的增多全心假想教诲课程。

此外还发现,在教诲历程中动态过滤掉上风为零的指示语,并构建包含多种本事的混杂指示语的教诲批次,有助于提高数学、推理和编码的性能。终末,从多样系统指示中取样对于确保模子在推理和编码方面保持指示侍从本事并在多样任务中进展出色至关伏击。

由于其限制空前,要为两万亿个参数模子扩张RL,还需要调动底层RL基础门径。

他们优化了MoE并行化的假想,从而加速了迭代速率;并开荒了一个完全异步的在线RL教诲框架,提高了无邪性。

现存的散布式教诲框架会葬送策画内存以将所有模子堆叠在内存中,比拟之下,他们新基础架构简略将不同模子无邪分拨到不同GPU上,并把柄策画速率在多个模子之间均衡资源。

与前几代家具比拟,这一革命使教诲恶果提高了约10倍。

One More Thing

要知谈,由于昨天DeepSeek发了新论文,搞得奥特曼王人坐不住了,飞速出来发声:

但,谁知谈中途又杀出个Llama 4?!

前有猛虎,后有虎豹,OpenAI你果然得加油了……

网友嘲谑谈,当奥特曼一睁眼,看到Llama 4来了,而况Llama 4的本钱比GPT-4.5裁汰了3个数目级后——

他的景况一定是酱婶儿的:

以及比拟Llama,咫尺可能微妙低调的DeepSeek,可能不知谈什么时候倏得就会推出DeepSeek R2和V4…同在杭州的通义千问也劲头十足,Llama也好GPT也好,基本成为平行参考了。

太平洋这头,仍是入手落地应用和智能体了。

参考聚合:

[1]https://www.llama.com/

[2]https://ai.meta.com/blog/llama-4-multimodal-intelligence/

[3]https://x.com/AIatMeta/status/1908598456144531660

[4]https://x.com/lmarena_ai/status/1908601011989782976

[5]https://x.com/IOHK_Charles/status/1908635624036590070

新浪声明:此音信系转载改过浪调和媒体,新浪网登载此文出于传递更多信息之主见,并不虞味着赞同其不雅点或阐发其描述。著述实质仅供参考,不组成投资建议。投资者据此操作,风险自担。 海量资讯、精确解读,尽在新浪财经APP

海量资讯、精确解读,尽在新浪财经APP

拖累剪辑:凌辰 体育游戏app平台